Lo strano caso dell’intelligenza artificiale, che sa batterci ma non sa giocare

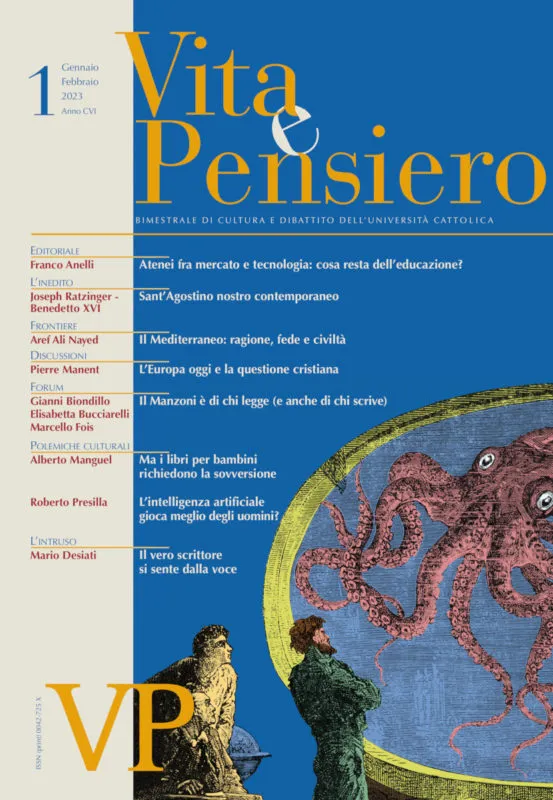

Per gentile concessione dell’editore, pubblichiamo di seguito l’articolo di Roberto Presilla sull’intelligenza artificiale contenuto nel numero 1 del 2023 (gennaio-febbraio) di Vita e Pensiero, rivista culturale dell’Università Cattolica del Sacro Cuore, in uscita oggi, giovedì 16 marzo. L’autore insegna Filosofia contemporanea alla Pontificia Università Gregoriana ed è direttore del Forum delle associazioni familiari. Si occupa di questioni legate al significato e alla verità, con attenzione alla formazione della mentalità.

* * *

Sembra ieri, ma sono passati già più di venticinque anni dalla prima vittoria di una macchina contro il campione mondiale di scacchi. Era il 1997 quando Deep Blue, un computer di Ibm, riuscì a battere Garry Kasparov nel corso di sei partite (due vittorie per il computer, una per Kasparov, tre patte). Kasparov contestò sia il modo in cui si era svolta la partita sia il fatto che la cosa gli era stata presentata come un esperimento scientifico, mentre Ibm la sfruttò per farsi pubblicità.

Già da questo episodio si capisce che il confronto tra intelligenza umana e intelligenza artificiale è una questione che scotta. Da allora le cose sono andate peggiorando, se si “tifa” per gli umani: nel 2009 Pocket Fritz 4, un software che gira su uno smartphone, ha vinto la Copa Mercosur a Buenos Aires. Un dato interessante: Deep Blue, un supercomputer, esaminava circa 200 milioni di mosse al secondo, mentre in quell’occasione Pocket Fritz 4 ne ha esaminate meno di 20.000 al secondo. È evidente quanto sia superiore la performance del secondo rispetto al primo.

Negli anni in cui Deep Blue batteva Kasparov, nel mondo della ricerca era frequente il confronto con il go, altro celebre gioco di strategia, che era considerato pressoché impossibile da giocare per un computer. Questa situazione è cambiata nel 2016, quando la londinese DeepMind, acquistata due anni prima da Google, riuscì a battere Lee Sedol, uno dei più forti giocatori al mondo, con AlphaGo, un programma basato su reti neurali profonde.

Negli anni in cui Deep Blue batteva Kasparov, nel mondo della ricerca era frequente il confronto con il go, altro celebre gioco di strategia, che era considerato pressoché impossibile da giocare per un computer. Questa situazione è cambiata nel 2016, quando la londinese DeepMind, acquistata due anni prima da Google, riuscì a battere Lee Sedol, uno dei più forti giocatori al mondo, con AlphaGo, un programma basato su reti neurali profonde.

DeepMind si è superata l’anno scorso, creando DeepNash, un’intelligenza artificiale in grado di battere molti giocatori umani esperti a Stratego, un gioco di strategia in cui i giocatori non hanno tutta l’informazione a disposizione.

Il go (nome giapponese; quello cinese è weiqi, quello coreano baduk) è considerato un gioco astratto di strategia pura, dato che soddisfa tutti e tre i criteri normalmente accettati: ha una dimensione narrativa minima; i risultati dipendono solo dalle scelte dei giocatori, senza input casuali; ogni giocatore ha un’informazione perfetta, nel senso che è a conoscenza di ogni situazione del gioco a cominciare dalla mossa iniziale (questo non significa che i giocatori abbiano un’informazione completa, per esempio che sappiano in che modo gioca l’avversario). Gli scacchi sono meno “astratti” in quanto il tema è chiaramente quello di una battaglia antica, e potrebbero essere definiti più “tattici”, dato che l’obiettivo strategico predefinito è catturare il re. Rispetto agli scacchi, il go è più antico, essendo attestato dal VI secolo a.C., il che lo rende probabilmente il più antico gioco da tavolo tuttora praticato.

Nel go le pedine, dette “pietre”, non si muovono una volta poggiate sulla scacchiera (goban), a meno che non vengano catturate dall’avversario. Lo scopo del gioco è controllare la porzione più ampia di territorio libero: il territorio controllato è quello circondato dalle proprie pietre, ma le pietre stesse non ne fanno parte. Occorre evitare di giocare in modo troppo conservativo (si controlla meno territorio di quanto si potrebbe), ma anche di non sbilanciarsi troppo, perché un gioco troppo ampio si presta a controffensive dell’avversario. Il goban ha 361 caselle (19×19) e il fatto che le pietre possano essere giocate praticamente ovunque e con restrizioni minime fa sì che l’insieme delle mosse possibili sia molto più ampio che negli scacchi: il numero di posizioni legittime – calcolato esattamente nel 2016 – può essere approssimato a 2,1 per 10170: per farsi un’idea della complessità del problema, si pensi che il numero degli atomi nell’universo è stimato in soli 1080!

Inoltre, la possibilità di una pietra di essere catturata dipende dalla sua posizione relativamente ad altre pietre. Un gruppo di pietre è vivo (non catturabile) se ha due occhi (controlla almeno due caselle libere indipendenti), mentre è morto se ha solo un occhio (è catturabile perché ha solo una libertà). La configurazione di uno spazio con 3, 4 o più caselle libere richiede una certa pratica per essere valutata, dato che la cattura non dipende semplicemente dalla possibilità di muovere un pezzo nello spazio occupato dal pezzo catturato (come negli scacchi), ma dal modo in cui una pietra è collegata ad altre.

Questo ha fatto sì che le strategie usate per costruire buoni programmi di scacchi si sono rivelate fallimentari per il gioco del go. Deep Blue immaginava i possibili risultati esaminando fino a 11 mosse successive a quella che doveva fare e confrontava i risultati con un’ampia libreria di partite già giocate. I programmi che hanno provato a fare lo stesso per il go negli anni Novanta venivano facilmente battuti da giocatori di basso livello. Negli anni 2000 sono stati costruiti programmi che usavano sistemi Monte Carlo per l’analisi dell’albero di decisione (l’insieme delle mosse possibili a partire da una mossa data), ossia proponevano delle mosse a caso che poi venivano valutate per capire se fossero buone. È stata questa tecnica, insieme al machine learning, a fare di AlphaGo la prima macchina in grado di battere un campione.

Se un computer è in grado di battere un uomo a un gioco che per definizione richiede intelligenza, significa che il computer è più intelligente? La domanda è almeno in parte mal posta: essere più intelligenti non significa semplicemente essere in grado di vincere, significa anche – per esempio – sapere se il confronto deve diventare una battaglia. Il maestro Sun Tzu, che sicuramente conosceva il go, sottolinea per esempio che il generale più grande non è colui che vince cento battaglie, ma colui che vince la guerra senza bisogno di combatterne nemmeno una. Il fatto che un computer sia in grado di giocare e vincere non significa necessariamente una sconfitta per l’uomo. Il go è un gioco a somma zero (la vittoria di uno costituisce la sconfitta dell’altro), ma la progettazione di computer sempre più “intelligenti” non è una partita di go: ragionare in questo modo presuppone l’idea che i computer siano avversari degli uomini.

D’altra parte, il fatto che una prestazione o una capacità ritenute tipicamente umane siano diventate appannaggio di un agente intelligente artificiale può creare disagio. È questa la situazione che Luciano Floridi, rielaborando Freud, definisce la quarta rivoluzione: dopo quelle di Copernico, Darwin e appunto Freud, la rivoluzione di Turing mostra che nello spazio delle decisioni razionali non esistono solo gli uomini.

La cosa può destabilizzarci, ma non è di per sé un male. Anzitutto, la ricerca su questo tipo di problemi ha portato a capire meglio l’intelligenza e a definire strategie più adeguate ad affrontare i problemi. L’intelligenza di Deep Blue consisteva nell’essere particolarmente metodico ed efficiente nello studiare le conseguenze di determinate mosse. La strategia di AlphaGo è a più strati: non punta a fare una cosa sola, ma punta a fare diverse cose per ottenere la vittoria. In un certo senso, assomiglia di più a un umano.

La ricerca nel campo dei giochi di strategia ha raggiunto un nuovo livello con DeepNash, la macchina in grado di giocare a Stratego. La complessità qui aumenta perché i giocatori non sanno quali pezzi abbiano di fronte: anche se il numero di pezzi è fissato, la loro disposizione in campo è segreta fino al momento dello scontro. Un computer che sia in grado di affrontare e vincere un uomo si avvicina molto di più a problemi della vita reale, in cui ci si trova a dover decidere senza avere tutte le informazioni che si vorrebbero.

Il modo con cui AlphaGo e DeepNash imparano non è frutto di un nostro insegnamento diretto. Gli uomini hanno progettato le reti, dando regole su come connettere i vari nodi, hanno definito i parametri e le regole di apprendimento di queste macchine, hanno dato un peso ai risultati in modo da favorire le strategie vincenti. Le macchine hanno lavorato poi per raggiungere il livello che le rende giocatori competenti. Due considerazioni si impongono.

Da un lato, è chiaro che molti aspetti di ciò che consideriamo intelligenza non sfuggono a un’indagine quantitativa. La retorica dell’unicità della vita mostra i suoi limiti di fronte alle poche (e prevedibili) scelte che ci si trova a dover fare, e che sono limitate nel numero, nelle opzioni, nelle situazioni. Le difficoltà che abbiamo illustrato nei giochi di strategia sono dovute al numero delle combinazioni possibili. Ma quando le combinazioni sono poche le difficoltà diminuiscono e l’analisi degli esiti possibili permette di vedere, a ritroso, le dinamiche che portano a decidere. Molti problemi che potremmo considerare difficili diventano molto più semplici quando si conoscano i fattori rilevanti. Questo vale anche per quegli aspetti logici dell’intelligenza che possono sembrare arcani, ma che sono relativamente semplici nel loro funzionamento. Al tempo stesso, sono sempre degli uomini a definire, indagare, perfezionare queste macchine (per il momento, almeno).

Dall’altro lato, non è chiaro, a un occhio filosofico, che cosa stia facendo AlphaGo. Possiamo dire che sta giocando a go? Michael Dummett ha proposto un argomento interessante: supponiamo che un minuscolo alieno atterri sulla Terra e non si renda conto che c’è vita intelligente. L’alieno capita su una scacchiera e comincia a notare alcune regolarità nel comportamento di quelli che chiamiamo “pezzi”. Supponiamo, aggiunge Dummett, che il nostro alieno sia in grado di osservare a lungo la scacchiera e i pezzi che vi si muovono sopra. Dopo un adeguato numero di osservazioni, l’alieno sarà in grado di riconoscere il comportamento dei pezzi, elaborando delle teorie che sulla base dell’osservazione saranno in grado di descrivere molti eventi. L’accuratezza di queste teorie potrebbe essere molto elevata, fino ad avere errori trascurabili: l’alieno potrebbe arrivare a predire gli sviluppi di determinati eventi, fino a prevedere l’esito di quella che noi chiamiamo una partita a scacchi.

Ora dobbiamo chiederci: una simile teoria sarebbe una descrizione del gioco degli scacchi? La risposta per Dummett è no: alla teoria mancherebbe una proposizione fondamentale, e cioè l’aver riconosciuto che quanto accade non è un fenomeno casuale, ma un’attività orientata a uno scopo ben preciso, che è vincere. Una descrizione che ometta le condizioni di vittoria non sarebbe una descrizione del gioco degli scacchi. Allo stesso modo, potremmo aggiungere, AlphaGo non sa di giocare a go: sa riconoscere una buona mossa rispetto a una cattiva, perché i suoi programmatori hanno definito per lui lo scopo da raggiungere. Ma quello scopo non fa parte della comprensione di AlphaGo, che non se ne rende conto.

L’autocoscienza, la capacità di riflettere su di sé, la possibilità di cambiare punto di vista: è questo quello che ci rende umanamente intelligenti. Anche sull’intelligenza possiamo cambiare idea: dal saper fare bene una cosa sola (riconoscere una sequenza di mosse vincenti tra tutte quelle possibili), al saper fare più cose contemporaneamente (immaginare mosse possibili e scegliere la migliore), al rendersi conto di quale sia lo scopo della vita. In fondo, abbiamo scoperto anni fa con Daniel Goleman che l’intelligenza emotiva può essere altrettanto importante per la vita sociale.

E comunque rimane il fatto che AlphaGo, DeepNash e compagnia hanno uno scopo solo se collaborano a imprese significative per noi. È sempre Floridi a sottolineare un parallelo tra gli agenti intelligenti artificiali e gli schiavi dell’antica Grecia, per ricordarci che già in passato abbiamo convissuto con agenti cui non riconoscevamo lo status di uomini. Non seguo questo argomento fino in fondo (la parte interessante è che gli agenti artificiali sono in grado di prendere decisioni da soli e quindi vanno considerati responsabili), anche perché lo studio di Hegel ci fa capire come la dialettica tra servo e padrone non dovrebbe lasciare tranquilli quanti immaginano il computer come un servo.

Sembra importante, invece, agire con una certa cautela e prima di tutto sforzarsi di comprendere che cosa davvero succede quando un computer è in grado di giocare a go o a scacchi. Nel secondo caso, per esempio, il problema matematico di come vincere è ormai superato: più o meno tutto quel che c’è da sapere sul mondo degli scacchi ce lo può dire un computer. In fondo, però, questo significa solo che una struttura matematica molto complessa è ora pienamente analizzabile. Non dovremmo dimenticarci che siamo stati noi a creare quella struttura, la cui complessità – come abbiamo detto – può essere considerata per certi versi maggiore di quella dello stesso universo.

Questo risolve l’angoscia nei confronti delle macchine intelligenti? No. Ma quella stessa angoscia dovrebbe esserci già di fronte ai nostri smartphone, ai nostri telefoni “intelligenti” che sono già in grado di fare cose che noi non sappiamo fare. Conviviamo già con agenti intelligenti artificiali, anzi li usiamo ogni giorno per molte operazioni. Il problema non è se queste macchine ci soppianteranno: dovremmo chiederci invece per quale motivo alcuni di noi sentano il bisogno di sostituire decisioni prese da esseri umani con decisioni giustificate da procedimenti matematici più o meno raffinati. Se le macchine dovessero davvero soppiantare l’intelligenza umana una volta per tutte, non potremmo nasconderci il fatto che, con ogni probabilità, saremmo stati noi a costruire il tutto.

0 commenti

Non ci sono ancora commenti.

I commenti sono aperti solo per gli utenti registrati. Abbonati subito per commentare!